长短大小样样精通!原始分辨率、超长视频输入:更灵活的全开源多模态架构Oryx

长短大小样样精通!原始分辨率、超长视频输入:更灵活的全开源多模态架构Oryx视觉数据的种类极其多样,囊括像素级别的图标到数小时的视频。现有的多模态大语言模型(MLLM)通常将视觉输入进行分辨率的标准化或进行动态切分等操作,以便视觉编码器处理。然而,这些方法对多模态理解并不理想,在处理不同长度的视觉输入时效率较低。

视觉数据的种类极其多样,囊括像素级别的图标到数小时的视频。现有的多模态大语言模型(MLLM)通常将视觉输入进行分辨率的标准化或进行动态切分等操作,以便视觉编码器处理。然而,这些方法对多模态理解并不理想,在处理不同长度的视觉输入时效率较低。

Sutton 等研究人员近期在《Nature》上发表的研究《Loss of Plasticity in Deep Continual Learning》揭示了一个重要发现:在持续学习环境中,标准深度学习方法的表现竟不及浅层网络。研究指出,这一现象的主要原因是 "可塑性损失"(Plasticity Loss):深度神经网络在面对非平稳的训练目标持续更新时,会逐渐丧失从新数据中学习的能力。

Google DeepMind的SCoRe方法通过在线多轮强化学习,显著提升了大型语言模型在没有外部输入的情况下的自我修正能力。该方法在MATH和HumanEval基准测试中,分别将自我修正性能提高了15.6%和9.1%。

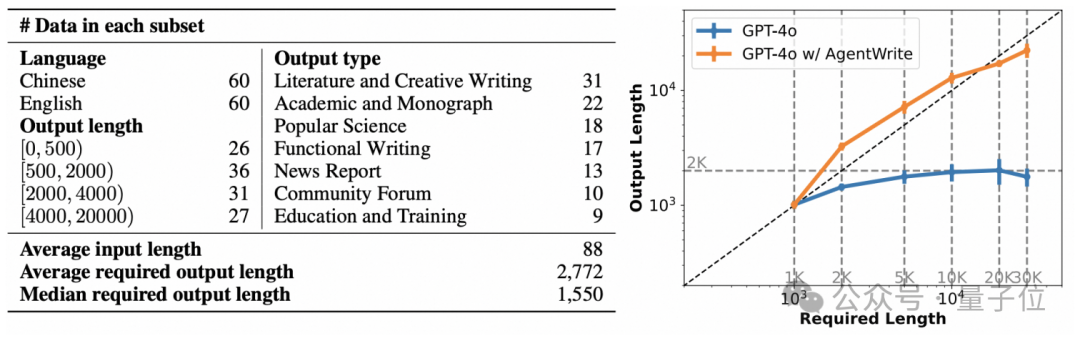

仅需600多条数据,就能训练自己的长输出模型了?!

9月26日,人工智能及大数据科技企业合合信息正式挂牌科创板,为三年IPO冲刺征程画上句号。

SafeEar是一种内容隐私保护的语音伪造检测方法,其核心是设计基于神经音频编解码器的解耦模型,分离语音声学与语义信息,仅利用声学信息检测,包括前端解耦模型、瓶颈层和混淆层、伪造检测器、真实环境增强四部分。

Scale AI早早踩对了风口,如今终于一飞冲天了,公司的2024年年化收入预计达到近10亿美元。

针对影视游戏、具身智能领域,推出两款大模型内容和数据引擎。

这场AI革命发生在一个非常有趣的时刻,因为在同一时间,我们基本上正处于一场生物学革命之中,我们从生物工程方法中生成了大量数据,并将新型药物、新型模式组合在一起,就像乐高积木一样,现在我们可以将各种抗体和小分子连接起来,创造出能做新事情的结合物。

Skild AI 是一家位于匹兹堡的初创公司,由两位前 CMU 教授创立,旨在打造具身智能的通用大脑。Skild 宣称其模型展示了无与伦比的泛化和涌现能力,并且有多于竞争对手 1000 倍的训练数据。