动态场景,开放文本查询!清华哈佛联合建模4D语言场 | CVPR 2025

动态场景,开放文本查询!清华哈佛联合建模4D语言场 | CVPR 20254D LangSplat通过结合多模态大语言模型和动态三维高斯泼溅技术,成功构建了动态语义场,能够高效且精准地完成动态场景下的开放文本查询任务。该方法利用多模态大模型生成物体级的语言描述,并通过状态变化网络实现语义特征的平滑建模,显著提升了动态语义场的建模能力。

搜索

搜索

4D LangSplat通过结合多模态大语言模型和动态三维高斯泼溅技术,成功构建了动态语义场,能够高效且精准地完成动态场景下的开放文本查询任务。该方法利用多模态大模型生成物体级的语言描述,并通过状态变化网络实现语义特征的平滑建模,显著提升了动态语义场的建模能力。

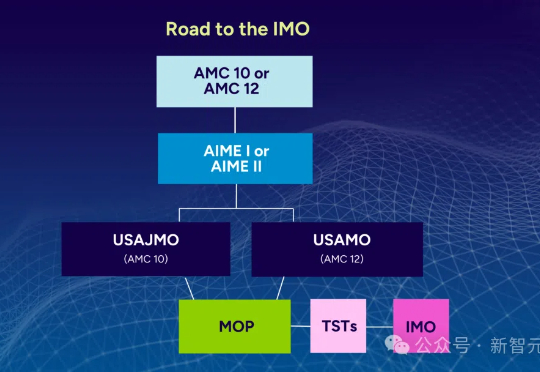

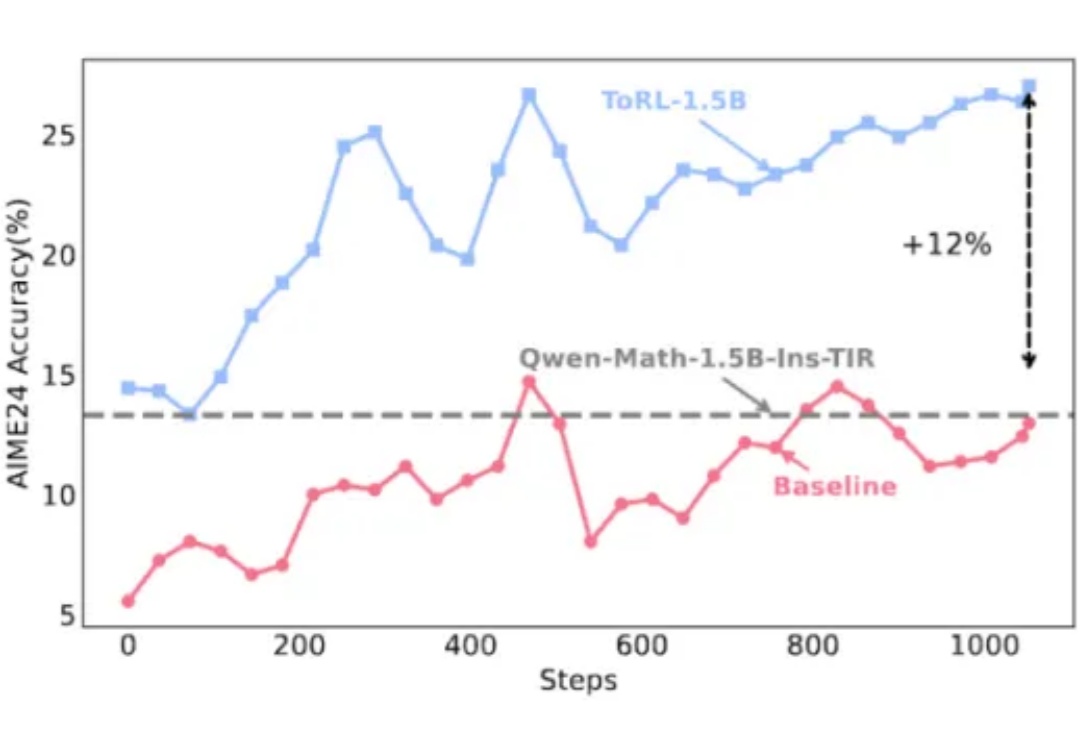

在数学推理中,大语言模型存在根本性局限:在美国数学奥赛,顶级AI模型得分不足5%!来自ETH Zurich等机构的MathArena团队,一下子推翻了AI会做数学题这个神话。

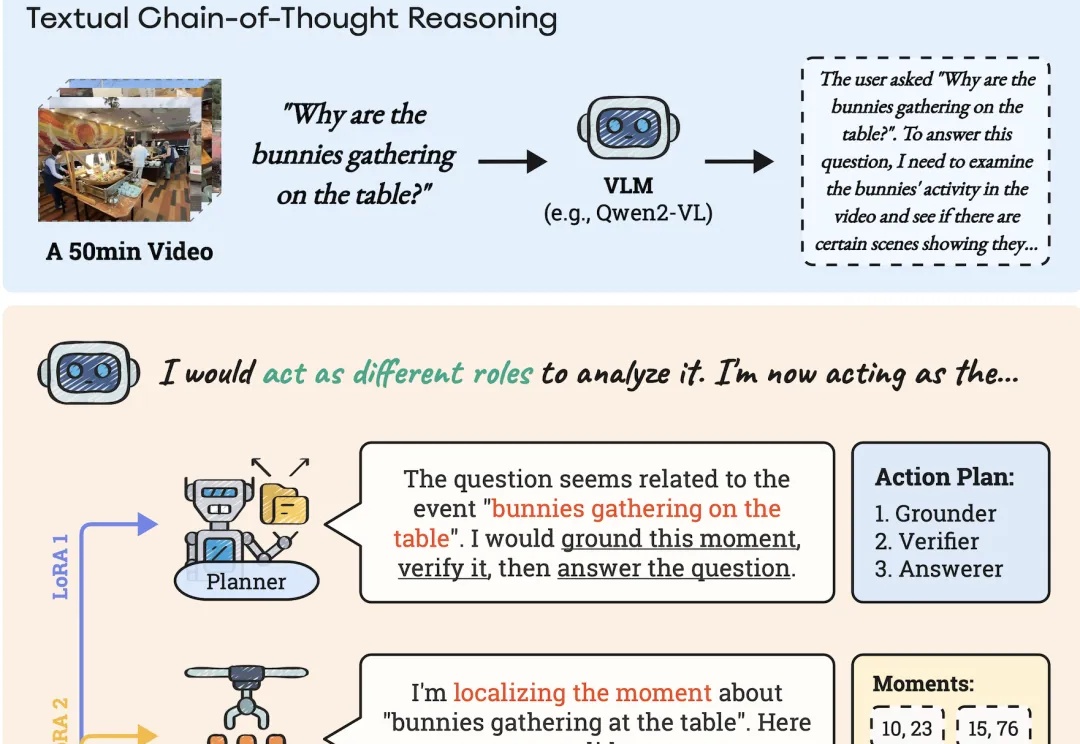

AI能像人类一样理解长视频。

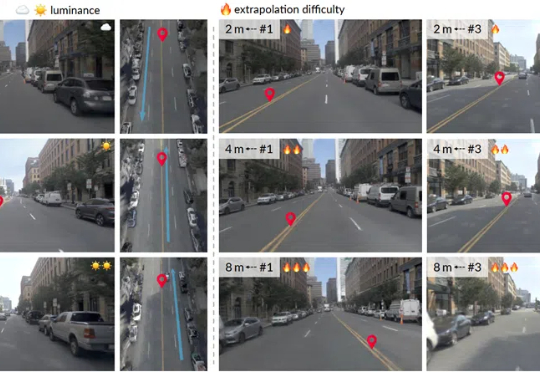

在自动驾驶领域,高精度仿真系统扮演着 “虚拟练兵场” 的角色。工程师需要在数字世界中模拟暴雨、拥堵、突发事故等极端场景,反复验证算法的可靠性。

众所周知,DeepSeek R1 这种模型在推理任务上很能打,尤其是在数学和编程这些逻辑性强的领域。那么我们能直接把这种强大的推理能力搬到 DeepSearch 这种需要动态规划、多轮交互的深度搜索场景里吗?

大家好,我是小瑶,今天是你们的 AI 前排吃瓜 + 技术解读博主。

太阳是地球生命繁衍的基础。

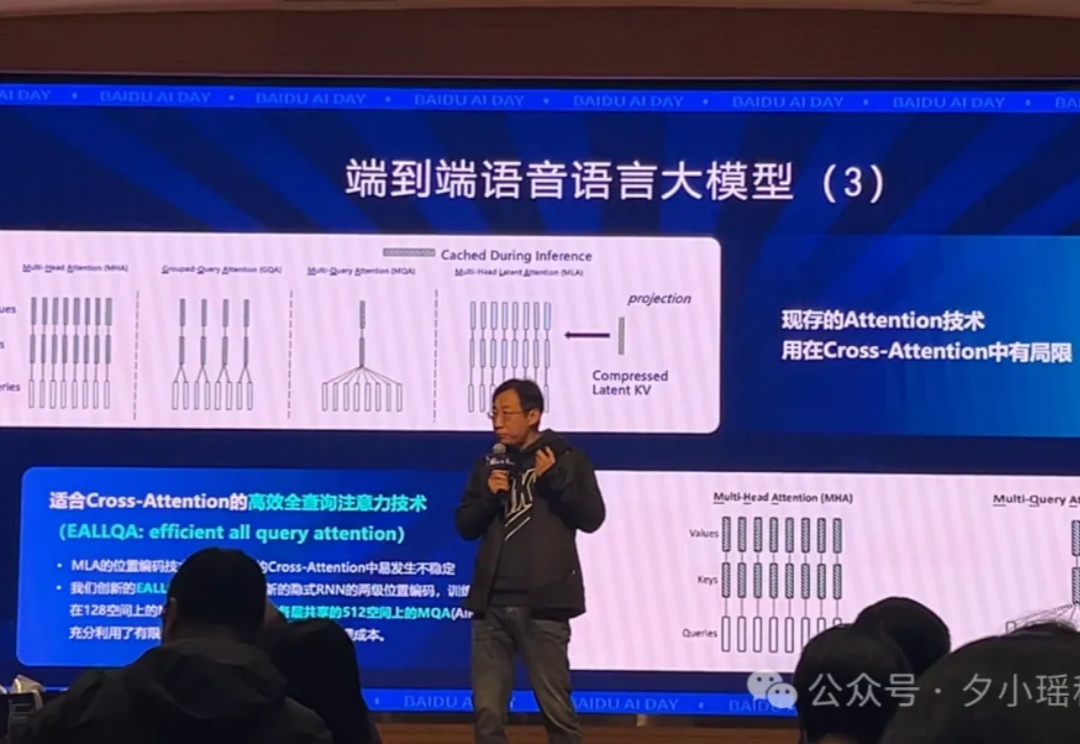

在大模型推理能力提升的探索中,工具使用一直是克服语言模型计算局限性的关键路径。不过,当今的大模型在使用工具方面还存在一些局限,比如预先确定了工具的使用模式、限制了对最优策略的探索、实现透明度不足等。

LLM正推动推荐系统革新,以用户表征为「软提示」的范式开辟了高效推荐新路径。在此趋势下,淘天团队发布了首个基于用户表征的个性化问答基准UQABench,系统评估了用户表征的提示效能。

4月1日,途牛旅游网自主研发的“AI助手小牛”旅游应用Agent正式上线途牛旅游APP、“AI助手小牛”小程序。“AI助手小牛”结合旅行垂直应用场景与开源大模型(DeepSeek、通义千问),实现了机票、酒店、火车票快捷查询、预订服务,能够为用户提供智能、专业的“0搭售"旅游服务方案。