无需人类或GPT-4打标签!南大&旷视研究院无监督范式大幅降低视觉大模型对齐成本

无需人类或GPT-4打标签!南大&旷视研究院无监督范式大幅降低视觉大模型对齐成本不用打标签,也能解决视觉大模型的偏好对齐问题了。

不用打标签,也能解决视觉大模型的偏好对齐问题了。

CVPR正在进行中,中国科研力量再次成为场内外焦点之一。

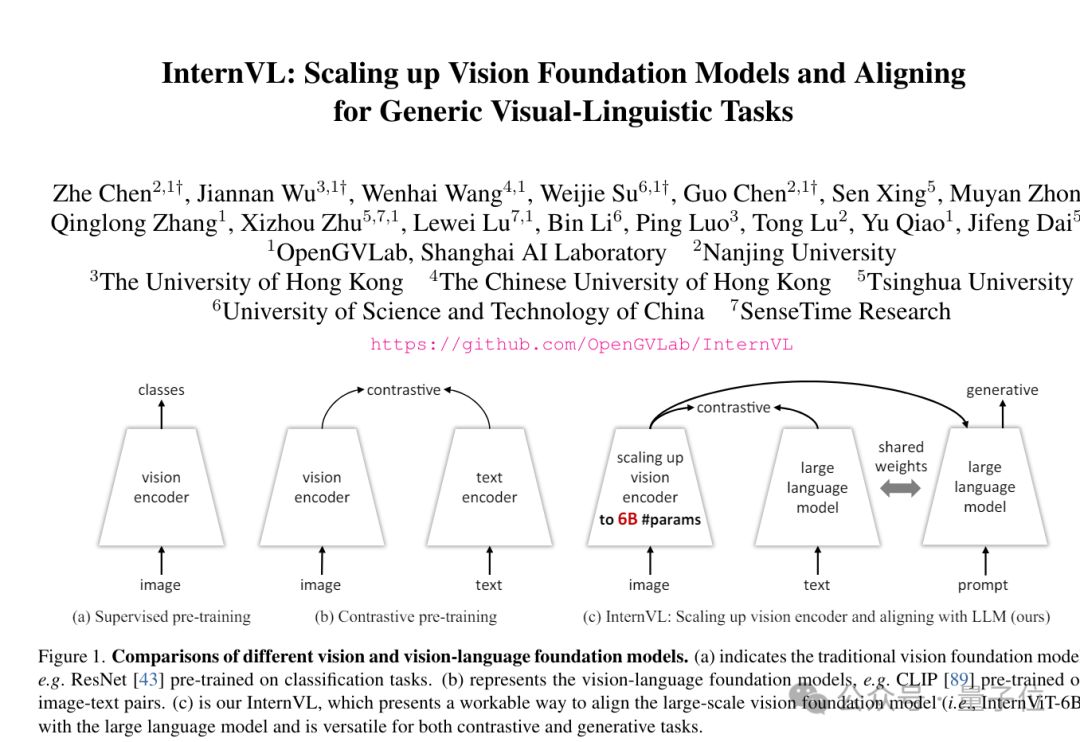

与 DeiT 等使用 ViT 和 Vision-Mamba (Vim) 方法的模型相比,ViL 的性能更胜一筹。

Transformer 在大模型领域的地位可谓是难以撼动。不过,这个AI 大模型的主流架构在模型规模的扩展和需要处理的序列变长后,局限性也愈发凸显了。Mamba的出现,正在强力改变着这一切。它优秀的性能立刻引爆了AI圈。

12月5-6日,主题为“未来AI设计”的美图创造力大会在厦门举行。美图公司发布自研AI视觉大模型MiracleVision(奇想智能)4.0版本,主打AI设计与AI视频。

UC伯克利的CV三巨头推出首个无自然语言的纯视觉大模型,第一次证明纯CV模型也是可扩展的。更令人震惊的是,LVM竟然也能做对图形推理题,AGI火花再次出现了?计算机视觉的GPT时刻,来了!

训完130亿参数通用视觉语言大模型,只需3天!北大和中山大学团队又出招了——在最新研究中,研究团队提出了一种构建统一的图片和视频表征的框架。利用这种框架,可以大大减少VLM(视觉语言大模型)在训练和推理过程中的开销。

AI能理解搞笑视频笑点在哪里了。北大等团队开源视觉语言大模型Video-LLaVA,将图像和视频表示对齐到统一的视觉特征空间,在13个图片和视频基准上达到先进的性能。

夸克网盘电脑端播放器已经支持视频5倍速播放、4K画质和多音轨播放等能力。在自研的AI视觉大模型技术帮助下,升级后的夸克网盘播放器支持AI字幕和文稿生成,更加方便用户理解和管理内容

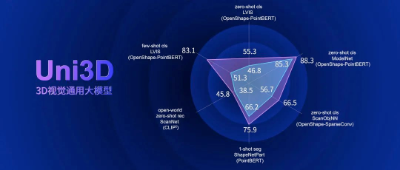

最近,智源、清华和北大联合发布了全新的10亿参数的3D视觉通用模型——Uni3D,在主流3D视觉能力上取得了全方位的性能突出!