ICML 2024演讲爆火!Meta朱泽园揭秘大模型内心世界:不同于人类的2级推理

ICML 2024演讲爆火!Meta朱泽园揭秘大模型内心世界:不同于人类的2级推理大语言模型 (LLM) 是如何解数学题的?是通过模板记忆,还是真的学会了推理思维?

搜索

搜索

大语言模型 (LLM) 是如何解数学题的?是通过模板记忆,还是真的学会了推理思维?

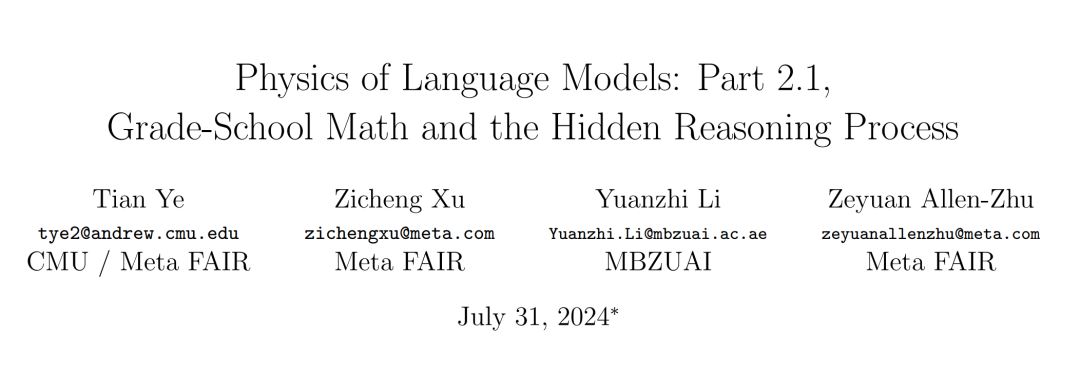

在这篇文章中,笔者将讨论以下几个问题: • 什么是语义路由 • RAG 路由的不同场景

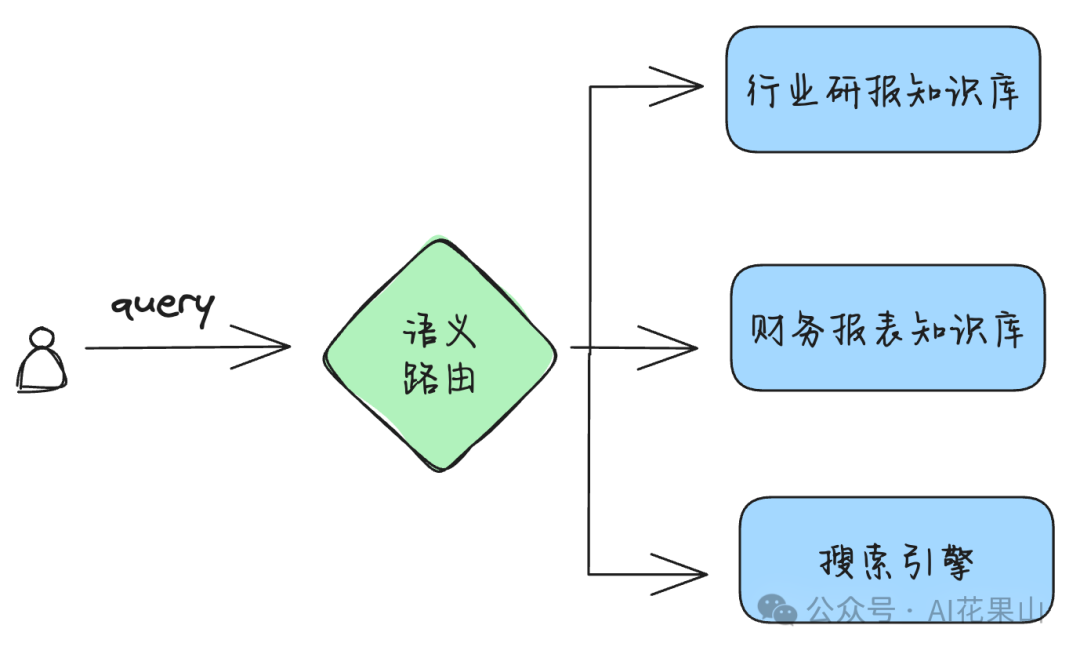

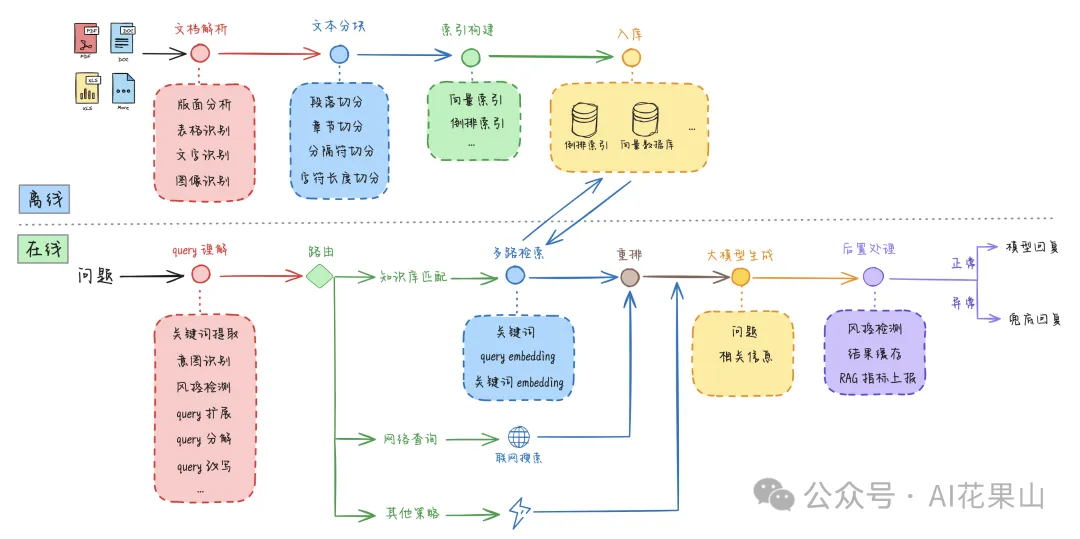

在这篇文章中,笔者将讨论以下几个问题: • 为什么要进行 query 理解 • query 理解有哪些技术(从 RAG 角度) • 各种 query 理解技术的实现(基于 LangChain)

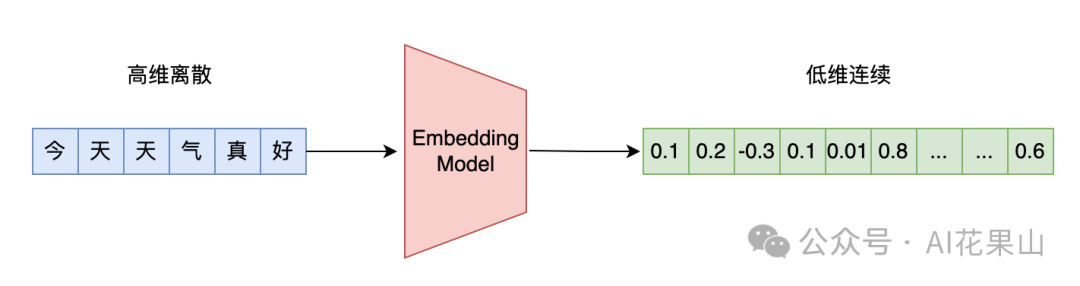

在本篇文章中,笔者将讨论以下几个问题: • 向量模型在 RAG 系统中的作用 有哪些性能不错的向量模型(从 RAG 角度) 不同向量模型的评测基准 MTEB 业务中选择向量模型有哪些考量 如何 Finetune 向量模型

灵活评估任意系统,轻松添加实验工具。

『RAG 高效应用指南』系列将就如何提高 RAG 系统性能进行深入探讨,提供一系列具体的方法和建议。同时读者也需要记住,提高 RAG 系统性能是一个持续的过程,需要不断地评估、优化和迭代。

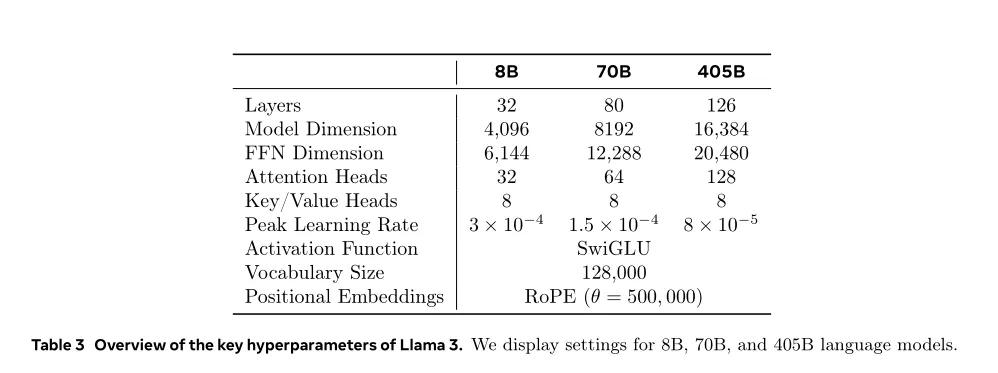

Llama 3.1 刚刚发布,你是否已经尝试了呢?就算你的个人计算机是最近的顶尖配置,运行其中最小的 8B 版本可能也依然会有明显延迟。为了提升模型的推理效率,研究者想出了多种多样的方法,但其中很多都会让模型牺牲一些准确度。

7月上旬,多位在字节跳动旗下免费阅读平台番茄小说更新作品的网络文学作者,收到了后台系统发送的“AI训练补充协议”签署提醒。其中提到,一旦签署,其作品内容及相关信息,将被用于平台AI模型训练或其他技术研发应用场景。

单卡搞定Llama 3.1(405B),最新大模型压缩工具来了!

不同类型的数据配比如何配置:先通过小规模实验确定最优配比,然后将其应用到大模型的训练中。 Token配比结论:通用知识50%;数学与逻辑25%;代码17%;多语言8%。