少即是多!10亿参数「小巨人」击败ChatGPT

少即是多!10亿参数「小巨人」击败ChatGPT只有10亿参数的xLAM-1B在特定任务中击败了LLM霸主:OpenAI的GPT-3.5 Turbo和Anthropic的Claude-3 Haiku。上个月刚发布的苹果智能模型只有30亿参数,就连奥特曼都表示,我们正处于大模型时代的末期。那么,小语言模型(SLM)会是AI的未来吗?

搜索

搜索

只有10亿参数的xLAM-1B在特定任务中击败了LLM霸主:OpenAI的GPT-3.5 Turbo和Anthropic的Claude-3 Haiku。上个月刚发布的苹果智能模型只有30亿参数,就连奥特曼都表示,我们正处于大模型时代的末期。那么,小语言模型(SLM)会是AI的未来吗?

GPT-4o或许还得等到今年秋季才对外开放。不过,由法国8人团队打造的原生多模态Moshi,已经实现了接近GPT-4o的水平,现场演示几乎0延迟,AI大佬纷纷转发。

最近,公司全体同事都在疯狂沉迷这款《大闹天宫MBTI》测试!各种直击打工人的灵魂拷问,让所有i人和e人在职场极限场景中反复拉扯。国产黑马和上影打造的原汁原味《大闹天宫》画风,简直让人一秒穿越回童年。

开源大语言模型(LLM)百花齐放,为了让它们适应各种下游任务,微调(fine-tuning)是最广泛采用的基本方法。基于自动微分技术(auto-differentiation)的一阶优化器(SGD、Adam 等)虽然在模型微调中占据主流,然而在模型越来越大的今天,却带来越来越大的显存压力。

检索增强式生成(RAG)是一种使用检索提升语言模型的技术。

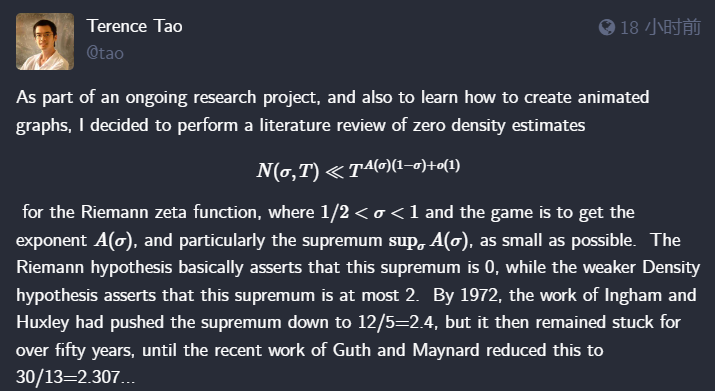

在 AI 的帮助下,越来越多的数学问题得到了解决。

无需录制团队、拍摄装备、摄像技能或后期编辑。

AI输入法不止输入。

无法阻止,不如拥抱

本质是生态之争

硅谷圈又双叒叕要地震了?

让手语越来越有存在感

张雪峰和AI,各做各的生意

在可信AI的世界里,需要的不仅是理性

趁国内大模型“虚弱”,抢跑者取胜。

Sora 再不开放,这饭就真捂臭了。。

3D 生成,一直在等待它的「ChatGPT时刻」。

沉睡了两千多年的兵马俑,苏醒了?

适当做减法,效果会更好。

只需Image Tokenizer,Llama也能做图像生成了,而且效果超过了扩散模型。

为了让大模型在特定任务、场景下发挥更大作用,LoRA这样能够平衡性能和算力资源的方法正在受到研究者们的青睐。

英伟达CEO黄仁勋的最新炉边谈话,被热议了。

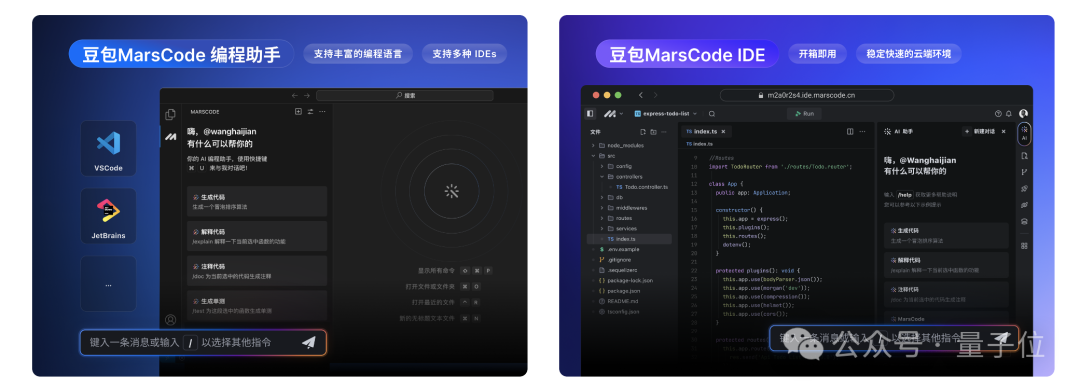

对于开发者来说,编码是一个既复杂又精细的过程。如何让这个过程变得更简单、更智能?如何进一步提升开发效率?豆包 MarsCode 近日正式发布,针对这些问题给出了新的答案。

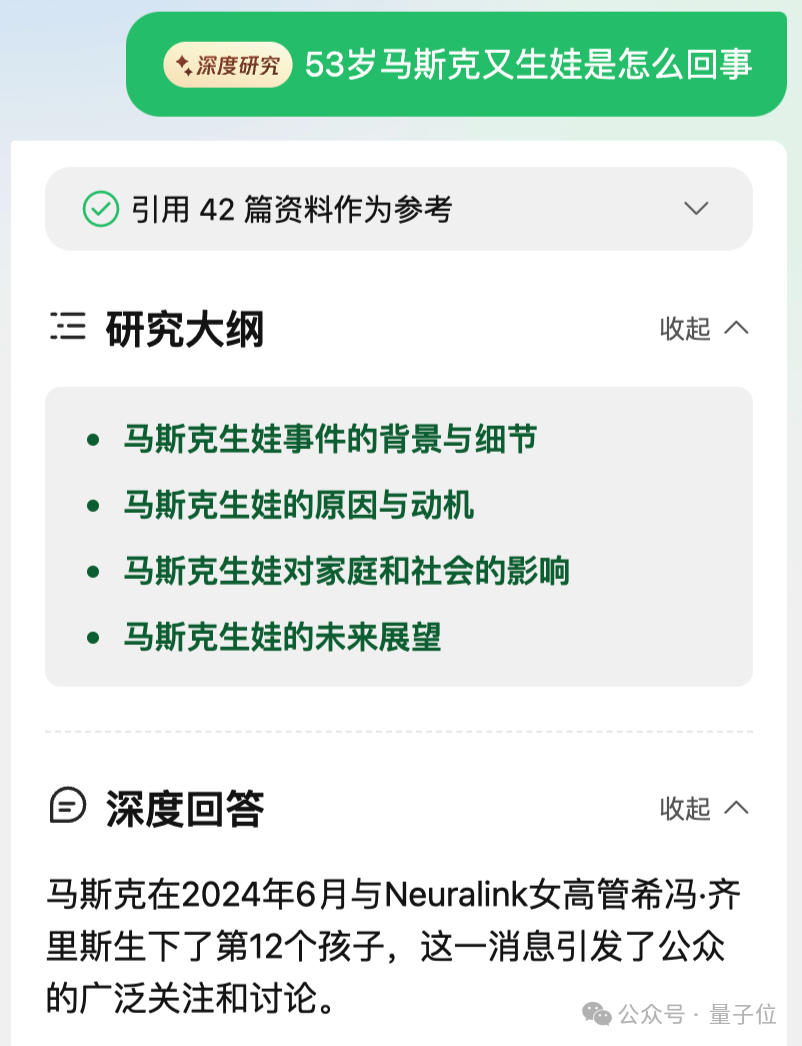

吃个瓜而已,AI居然写了份研究报告??

马斯克连回两条推文为xAI造势,宣布8月发布Grok 2,年底将推出在10万张H100上训练的Grok 3,芯片加持创新数据训练,打造对标GPT的新一代大语言模型。

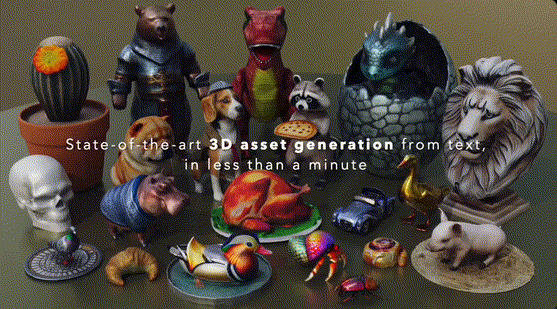

Meta的GenAI团队在最新研究中介绍了Meta 3D Gen模型:可以在不到1分钟的时间内从文本直接端到端生成3D资产。

「忙碌海狸」难题困扰了计算机科学家40多年。如今,来自全球各地20+业余开发者和数学家们,终于取得了突破性进展。他们抓到了第五只忙碌海狸——用Coq辅助证明,得到答案47176870。对此陶哲轩激动地表示,这再次体现了证明助手对数学研究协作的重要性。

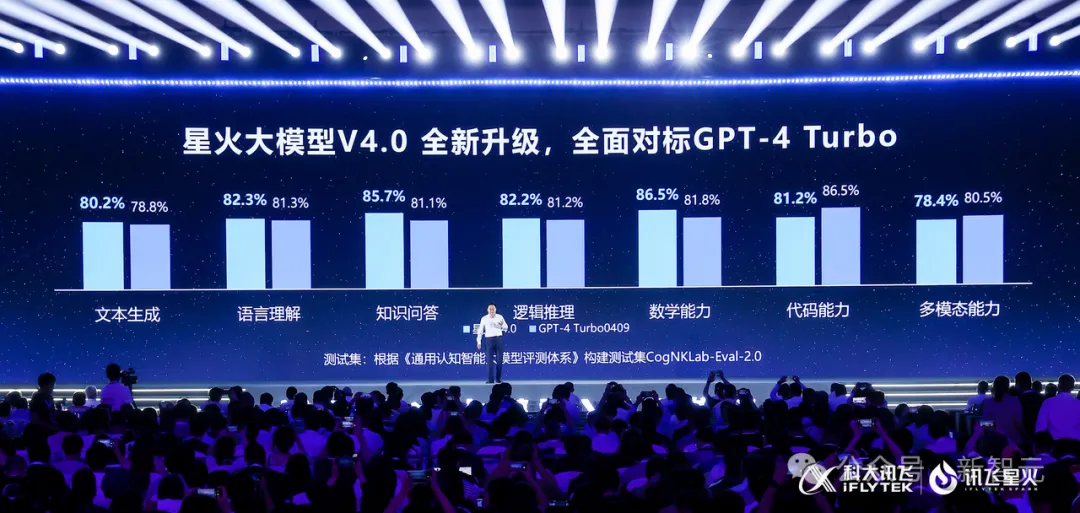

如何才是一台能真正帮到孩子的AI学习机?最近,搭载了星火4.0大模型,并全面升级AI 1v1答疑辅导实现了超拟人对话的讯飞AI学习机,堪称最省爸妈的AI神器。

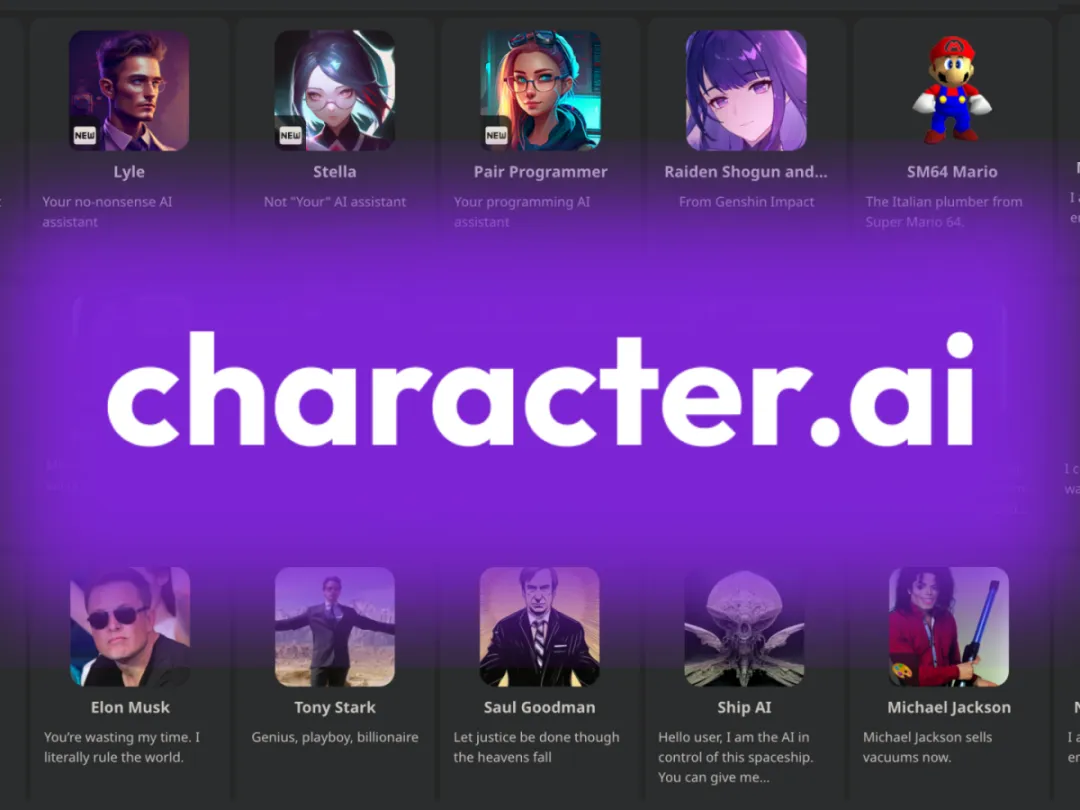

随着个性化聊天机器人的新鲜感逐渐消失,竞争也愈演愈烈。Meta Platforms 在去年秋天发布了以汤姆-布雷迪(Tom Brady)等名人为模型的聊天机器人后,上周开始测试由个人创建者制作的聊天机器人。谷歌也一直在开发一款用于创建和与定制聊天机器人对话的产品,最快可能在今年推出。

这是一篇两个月前就应该写的文章。