清华新VLA框架加速破解具身智能止步实验室“魔咒”,LLM开销节省4-6倍 | NeurIPS'24

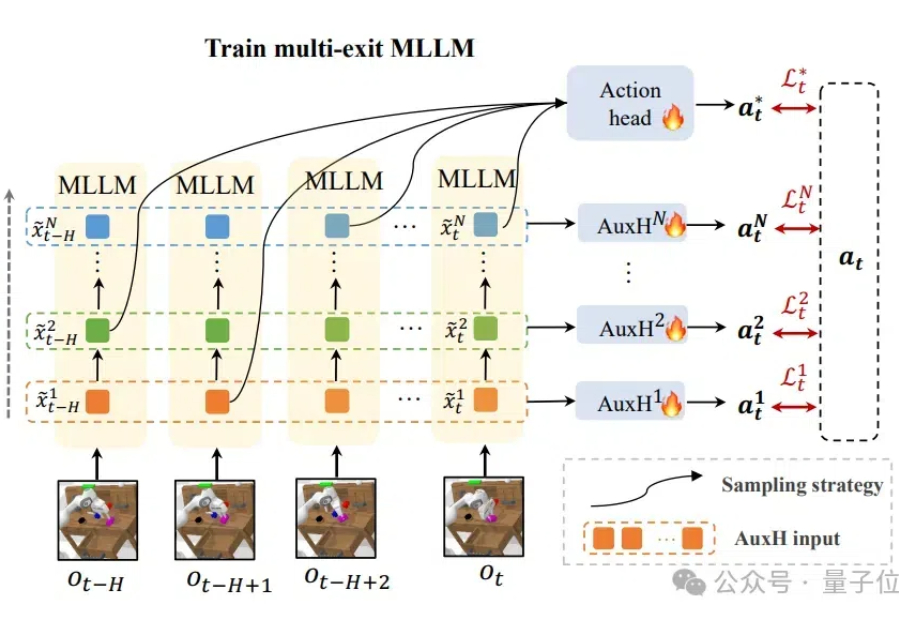

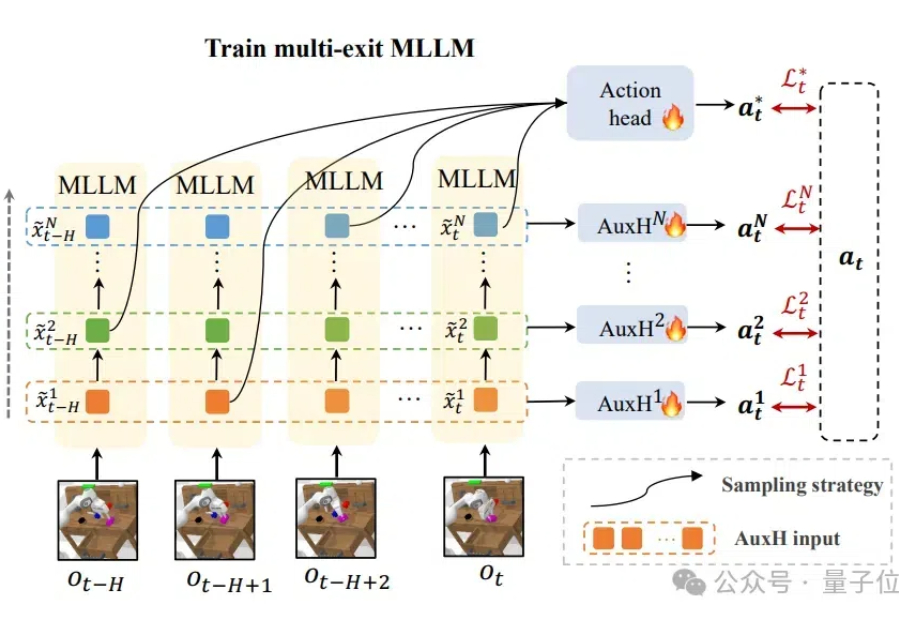

清华新VLA框架加速破解具身智能止步实验室“魔咒”,LLM开销节省4-6倍 | NeurIPS'24计算、存储消耗高,机器人使用多模态模型的障碍被解决了! 来自清华大学的研究者们设计了DeeR-VLA框架,一种适用于VLA的“动态推理”框架,能将LLM部分的相关计算、内存开销平均降低4-6倍。

搜索

搜索

计算、存储消耗高,机器人使用多模态模型的障碍被解决了! 来自清华大学的研究者们设计了DeeR-VLA框架,一种适用于VLA的“动态推理”框架,能将LLM部分的相关计算、内存开销平均降低4-6倍。

CRM作为企业软件中最大的板块之一,其价值毋庸置疑。传统CRM的本质是关系型数据库,在AI尤其是多模态技术的加成下,CRM从结构化数据向半结构化/非结构化数据的转变势在必行。

枢途科技(深圳)有限公司(以下简称「枢途科技」)近日完成数百万元天使轮融资,本轮由奇绩创坛投资,主要用于多模态大模型训练迭代、通用复合机器人结构升级等技术与产品的研发和交付。

BlueLM-V-3B 是一款由 vivo AI 研究院与香港中文大学联合研发的端侧多模态模型。该模型现已完成对天玑 9300 和 9400 芯片的初步适配,未来将逐步推出手机端应用,为用户带来更智能、更便捷的体验。

最近,奥特曼豪掷数千万美金购买域名、组建AI浏览器团队,展现了互联网的时代轮回,标志着AI互联网时代的来临。AI改造互联网,首当其冲的就是搜索引擎。几乎与奥特曼的动作同步,纳米搜索的出现,代表着我们正式进入「多模态内容创作引擎」的搜索引擎3.0时代。

尽管近期 Qwen2-VL 和 InternVL-2.0 的出现将开源多模态大模型的 SOTA 提升到了新高度,但巨大的计算开销限制了其在很多场景下的应用。

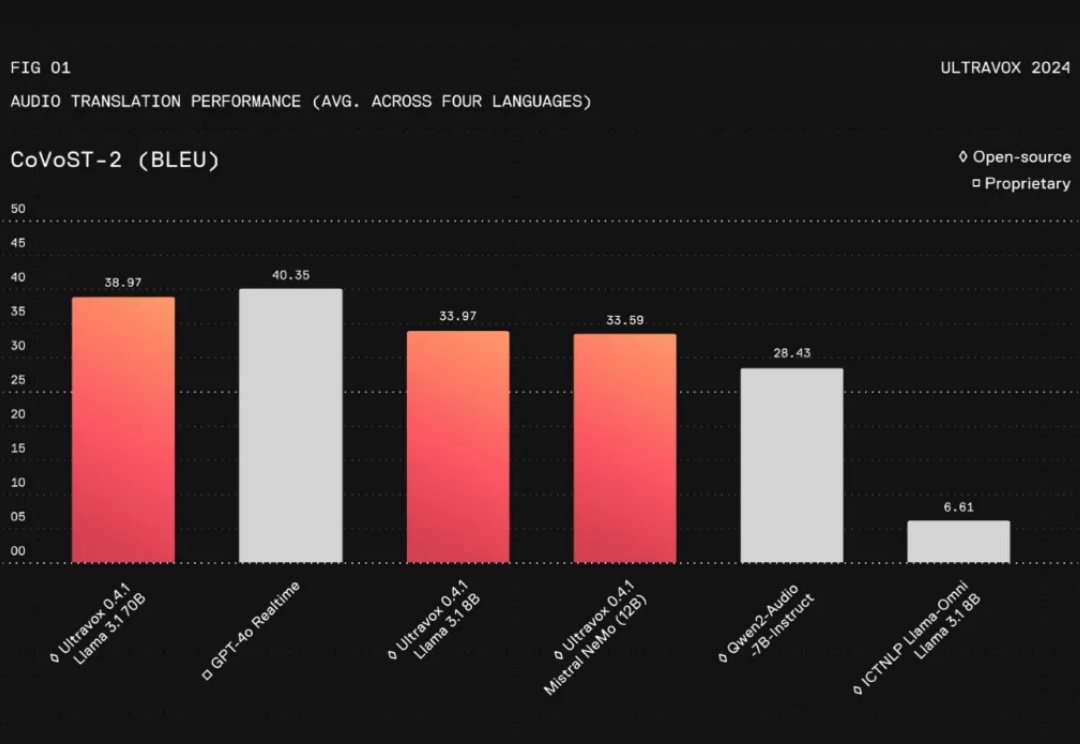

在人工智能领域,与AI进行无缝的实时交互一直是开发者和研究者面临的一大挑战。特别是将文本、图片、音频等多模态信息整合成一个连贯的对话系统,更是难上加难。尽管像GPT-4这样的语言模型在对话流畅性和上下文理解上取得了长足进步,但在实际应用中,这些模型仍然存在不足之处:

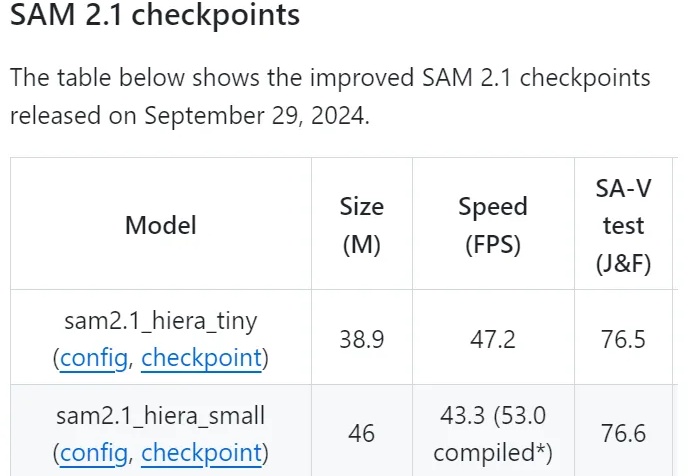

Meta最近开源了多个AI项目,包括图像分割模型SAM 2.1、多模态语言模型Spirit LM、自学评估器和改进的跨语言句子编码器Mexma等,提升了AI在图像处理和语音识别领域的能力,进一步推动了AI研究的进展。

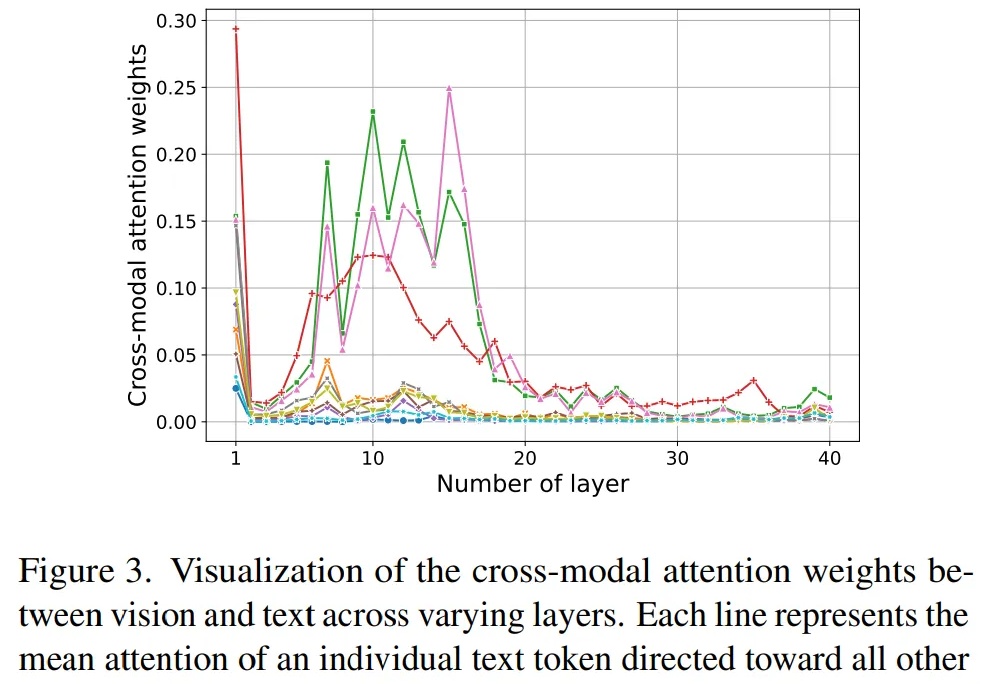

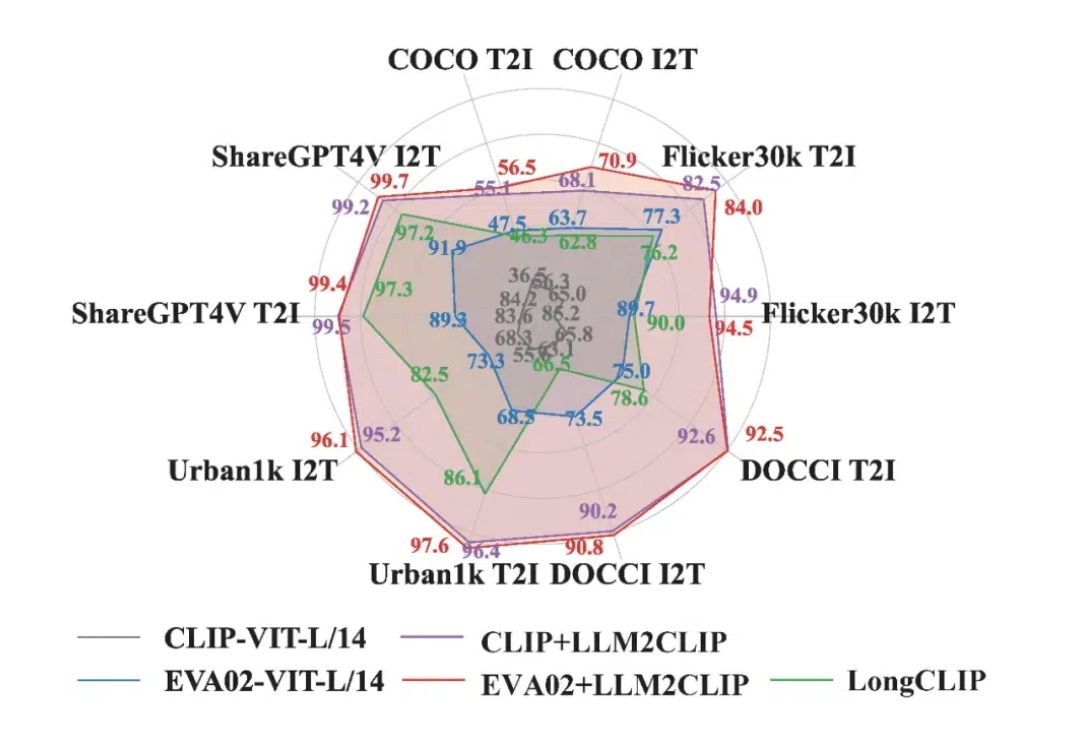

在当今多模态领域,CLIP 模型凭借其卓越的视觉与文本对齐能力,推动了视觉基础模型的发展。CLIP 通过对大规模图文对的对比学习,将视觉与语言信号嵌入到同一特征空间中,受到了广泛应用。

不知道从何时起,脑海里就有着阶跃星辰的多模态能力遥遥领先的印象。 无论去哪旅游,以前是用谷歌地图,现在基本都用「跃问」,看到长得奇特的建筑就拍来问问,还能跟 AI Chat 一下历史。 这不,最近来新加坡出差了,顺便旅旅游,就又用上了「跃问」。