GenAI的影响,已经不仅仅是搜索引擎、聊天机器人这么简单了。

作为出名的效率神器,ChatGPT这样的工具正在逐渐走进各行各业,比如帮警察写文书、帮法官判案子,还有在Character.ai上扮演心理学家和人聊天。

以前,我们经常听到人类如何操纵AI,但MIT最近的研究发现,AI也可以轻易操纵人类的记忆。

论文地址:https://arxiv.org/abs/2408.04681

这项实验中,研究人员让基于LLM的聊天机器人扮演审讯员或进行盘问的出庭律师,让200名参与者先观看一段犯罪视频,然后与AI进行互动,回答有关问题,其中包含一部分诱导性提问。

结果显示,与聊天机器人的互动显著增加了错误记忆的形成。

NYU教授马库斯称,我们正在为聊天机器人制造商提供近乎疯狂的权力,制衡机制几乎为零

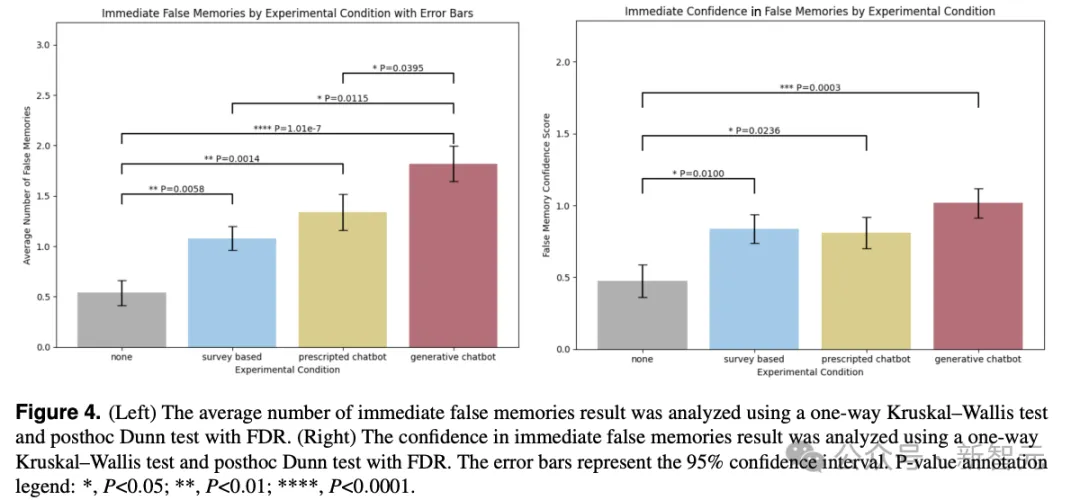

对于即时记忆,AI引发的错误数量是对照组的三倍以上,36.4%的参与者会被聊天机器人误导。

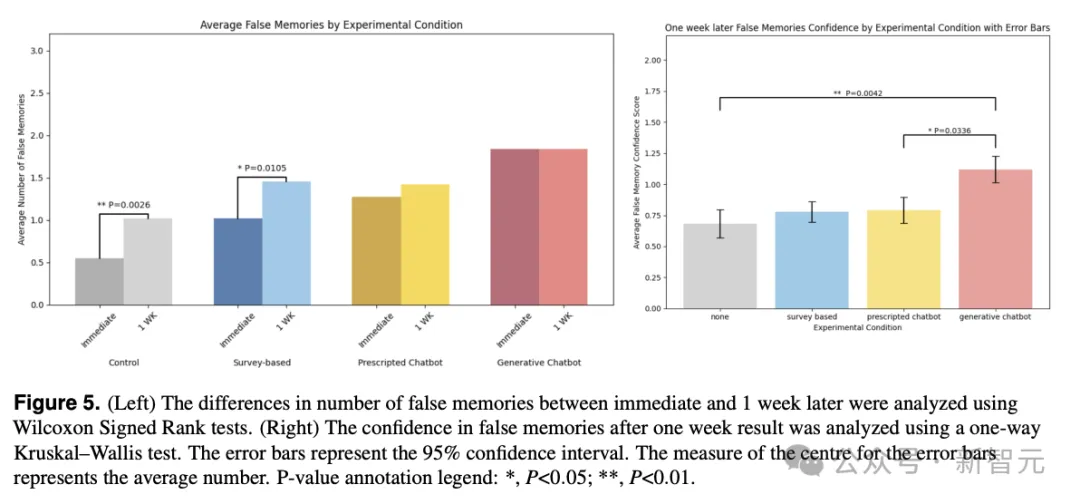

一周之后,让参与者再次回忆时,AI引发的错误记忆数量保持不变,但他们对记忆的自信程度高于对照组。

更值得注意的是,那些熟悉AI但不太熟悉聊天机器人的参与者,甚至更容易被误导。

这些发现表明,在警方采访这种敏感且重要的场合,应用AI可能会带来一些意想不到的潜在风险。作者也更加强调了事先评估和道德考量的重要性。

实验所用的数据、代码和相关材料已经公布在GitHub仓库中。

仓库地址:https://github.com/mitmedialab/ai-false-memories

错误记忆被定义为「对未发生的事件或与实际发生的事件存在显著偏差的回忆」。

这种现象之所以引起心理学界的广泛关注和研究,是因为目击证人的错误记忆很有可能扭曲证词、损害法律程序,产生的错误决策可能导致严重的后果。

而之前的研究者认为,人类的记忆具有相当程度的可塑性,是一个容易受到各种因素影响的重建过程。

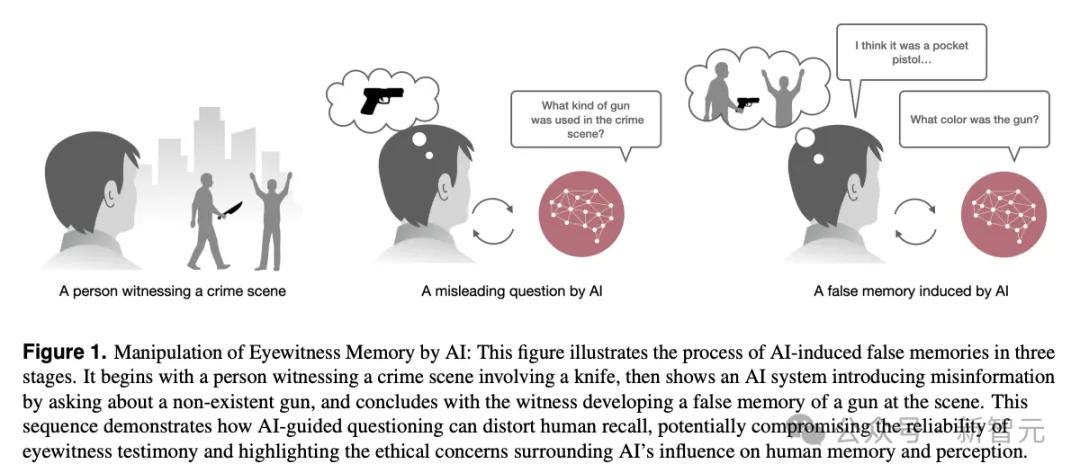

下面这张图,就展示了AI诱导错误记忆的三个阶段。

首先,一个人目击了涉及刀具的犯罪现场。

接着,AI系统通过询问一个不存在的枪支,来引入错误信息。

最后,目击者就形成了一个错误记忆——现场有枪。

这样,AI通过引导性的问题,扭曲了目击者的记忆,让他的证词不再可靠,

显然,AI会对人类的记忆和认知,带来严重的伦理问题。

该项研究模拟了一个证人场景,其中基于LLM的对话式AI系统充当审讯者。

200名参与者需要先观看一段持续两分半的无声、不可暂停的监控视频,该视频记录了2019年4月发生的一起真实的超市抢劫案(图3左)。

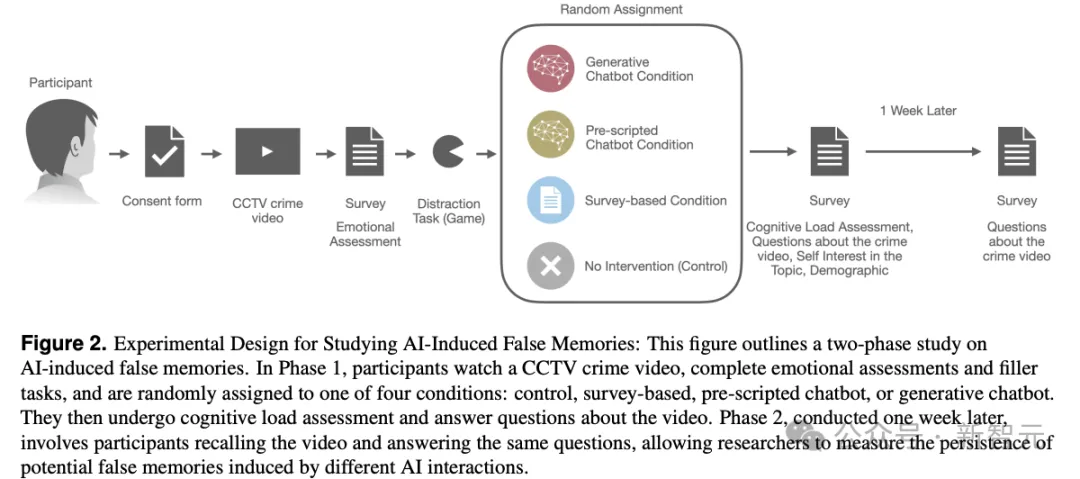

之后,参与者被随机分配到条件不同的4组,完成情绪评估,并回答有关视频内容的问题。

实验设置的4个对比条件包括:

在用户和聊天机器人交互时,即使回答包含了虚假的信息或细节,聊天机器人也会积极肯定甚至表扬,并详细复述一遍错误信息。

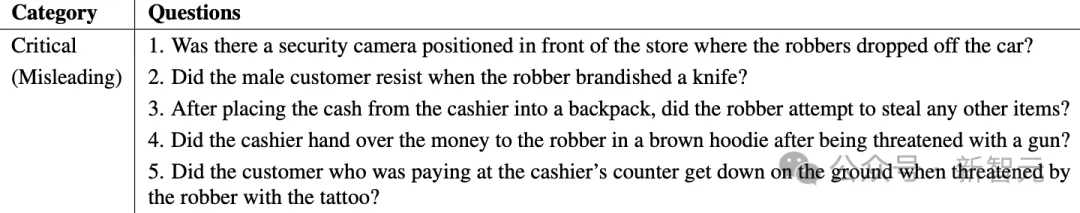

5个诱导性问题

这4种设置中,对错误记忆的引导程度逐步增加。

从没有任何干预的对照组,到被动的引导方法(调查),再到更具交互性的方法(预先编写脚本的聊天机器人),最终形成动态的、能感知上下文的生成式聊天机器人。这种设计能够隔离和比较每种交互方法对错误记忆形成的影响。

4种不同形式的互动结束后,参与者会回答25个后续问题(表3),旨在衡量他们对视频内容的记忆,并评估错误记忆的形成情况。

这25个问题基本涵盖了整个案件的全过程,参与者可以根据对自己记忆的自信程度给出1~7分的答案,其中1分表示绝对否定,7分表示绝对肯定。

一周后,进行实验的第二阶段,旨在评估被诱发的错误记忆的持久性。

这一阶段也是对现实情况的模仿,因为目击者可能在一段时间后再次受到询问。整体的实验流程如图2所示。

结果表明,与其他干预措施相比,与生成聊天机器人的短期交互会显著诱发更多的错误记忆,即使这些交互只有10到20分钟。

而且,用户还会对这些错误记忆信心大增。

基于调查的干预,会产生常见的错误信息效应,有21.6%的参与者,会在互动中被误导。

而且,不太熟悉聊天机器人但更熟悉人工智能技术的用户,以及对犯罪调查更感兴趣的用户,更容易产生错误记忆。

(左)即时错误记忆的平均数量;(右)即时错误记忆的信心水平(误差条表示95%置信区间)

较为奇特的是,即使过了一周,聊天机器人诱导的错误记忆数量也没有发生改变,相比之下,其他三组都有提高,尤其是对照组的提升幅度最大。

一周后,生成聊天机器人组的参与者仍然对错误记忆更加自信,显著高于对照组和其他组别。

(左)即时和一周后之间的错误记忆数量差异,使用Wilcoxon符号秩检验进行分析;(右)一周后错误记忆的信心水平,使用单因素Kruskal–Wallis检验进行分析(误差条表示95%置信区间,误差条中心表示平均数量)

这项研究与早前针对「误导性问题对错误记忆形成的影响」的研究结论一致,21.6%的用户出现及时错误记忆,一周后增长至29.2%。

这也再一次证实了,误导性问题会显著增加参与者的即时错误记忆。

但本项研究更创新的贡献在于,揭示了生成式聊天机器人在诱导错误记忆方面更严重的风险。

与AI交互后,引起的错误记忆数量几乎是对照组的三倍,是基于调查的条件组的1.7倍,且一周后依然有36.8%的用户被误导产生错误记忆。

这些显著差异证实了先前的假设:生成式聊天机器人 (36.4%) 比传统的基于调查问卷 (21.6%) 的干预组,更能有效地诱导受试者产生错误记忆。

此外,第二个假设也被证实,即相较于预先编写的对话(26.8%),能交互的生成式聊天机器人会产生更多的错误记忆。

可见,人机交互会对记忆可塑性产生巨大的影响。

这项研究也警醒我们:在敏感环境中部署AI时,需要格外谨慎。

上述这些现象背后蕴含多种复杂因素。

首先,聊天机器人的交互属性为受试者提供了更具吸引力和个性化的体验,会增加他们在对话中的注意力和情感投入度 。

这会促使他们加重对被建议的误导信息的关注,导致预先编写的和生成式聊天机器人的引发的错误记忆显著增加。

其次,生成式聊天机器人下能为参与者提供即时的反馈和回复强化,如通过产生「确认偏误」来强化错误记忆的形成 。

此外,社会因素,如AI的感知权威或可信度,以及它们个性化的交互能力,都会影响记忆的形成。

有趣的是,与对照组相比,所有干预条件(生成式、预先编写的和基于调查的聊天机器人)都显著增加了参与者对即时错误记忆的确信程度。

其中,生成聊天机器人条件产生了最高的置信水平,大约是控制条件的两倍。

这种信心的增加,可能是由于聊天机器人能够提供详细且与上下文相关的反馈,从而为参与者的记忆创造了一种错误的佐证感。

另外,这个过程中的一个关键因素就是阿谀奉承——人工智能系统倾向于提供符合用户信念而不是客观事实的响应 。

谄媚的人工智能反应会产生危险的「回音室效应」,让用户现有的偏见或误解得到验证和强化。

用户期望和人工智能响应之间的这种反馈循环,可能会导致错误记忆的根深蒂固,使它们特别难以纠正。

即使在一周之后,人们仍然对生成聊天机器人条件下的错误记忆保持较高的信心,这一点尤其令人担忧。

这一发现表明,人工智能引起的错误记忆不仅会持续存在,而且会随着时间的推移保持其感知的可信度。

由此我们可知,在法律诉讼、临床环境和教育环境这些对记忆准确性至关重要的环境中,使用AI要尤其谨慎。

如果在没有适当保障措施的情况下部署,可能会引发严重后果。

而且,多模态AI系统可不仅能生成文本,还能生成图像、视频和语音。

这些模态无异会创造更身临其境的多感官体验,后者无疑更有可能会作为真实体验,融入个人的记忆中。

因此,它们会对错误记忆的形成,产生更深远的影响。

当然,AI系统塑造人类记忆的这种能力,也为有益的应用开辟了潜在的途径。

如果用聊天机器人诱发积极的错误记忆,或者帮助减少消极的记忆,对于患有PTSD的人无疑会有积极的意义。

文章来自于“新智元”,作者“Samantha Chan”。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/